Wenn das Wall Street Journal die SEO-Agentur ersetzt

Das Wall Street Journal hat einen denkwürdigen Artikel über die Google-Suche verfasst. Der WSJ-Artikel klingt für mich ein wenig, als würde in der Allgemeinen Deutschen Imker-Zeitung ein Fachartikel über Schweineschlachtung publiziert werden. Verfasst von einem Kindergärtner.

Am 15.11.2019 veröffentlichte das „Wall Street Journal“ einen Artikel (3) mit dem Titel

„How Google Interferes With Its Search Algorithms and Changes Your Results“

und dem Untertitel

„The internet giant uses blacklists, algorithm tweaks and an army of contractors to shape what you see”

Übersetzt auf Deutsch: „Wie Google mit seinen Suchalgorithmen interagiert und Ihre Ergebnisse ändert“ – „Der Internetriese verwendet schwarze Listen, Algorithmus-Optimierungen und eine Armee von Auftragnehmern, um das zu gestalten, was Sie sehen“.

Wow. Das ist ja richtig schlimm. Zumindest, was dort in dieser reißerischen Überschrift steht. Schon hier ist der Experte sicherlich irritiert.

Und über den Rest des Artikels noch mehr.

Der Artikel liest sich im Grunde wie ein künstliches Konstrukt. Mit eingebauten Unwahrheiten. Die interviewten Experten haben den Artikel als sehr problematisch dargestellt. Wenn man den SEO-Experten Glauben schenken darf, dann wurden Aussagen sogar verfälscht (2).

Google möchte und muss die besten Resultate für Menschen ausliefern!

{{divider}}

Google verstehen: Part 1 – Autocomplete bzw. Suggest

Autocomplete (oder Suggest) macht Annahmen und Vorschläge bei der Eingabe verschiedener Suchphrasen. Annahmen, was die Suchintention einer Suchanfrage sein könnte, die dann mit Suchvorschlägen ergänzt werden können.

Das Ganze basiert auf dem Suchvolumen und der Wahrscheinlichkeit, nach was der Suchende googeln könnte. Bei bestimmten Themen geschieht dies sogar tagesaktuell.

Das Wall Street Journal hat dazu eine sehr merkwürdige Benchmark gefahren. Und er zeigt, wie schlimm es ist, wenn man vollkommen im Unklaren ist, was man dort macht und wie Stimmungsmache gegen Google dann publiziert wird.

Es waren mehrere Grafiken eingeblendet über das, was die Autosuggest-Funktionen von Google, DuckDuckGo und Bing den Nutzern anboten.

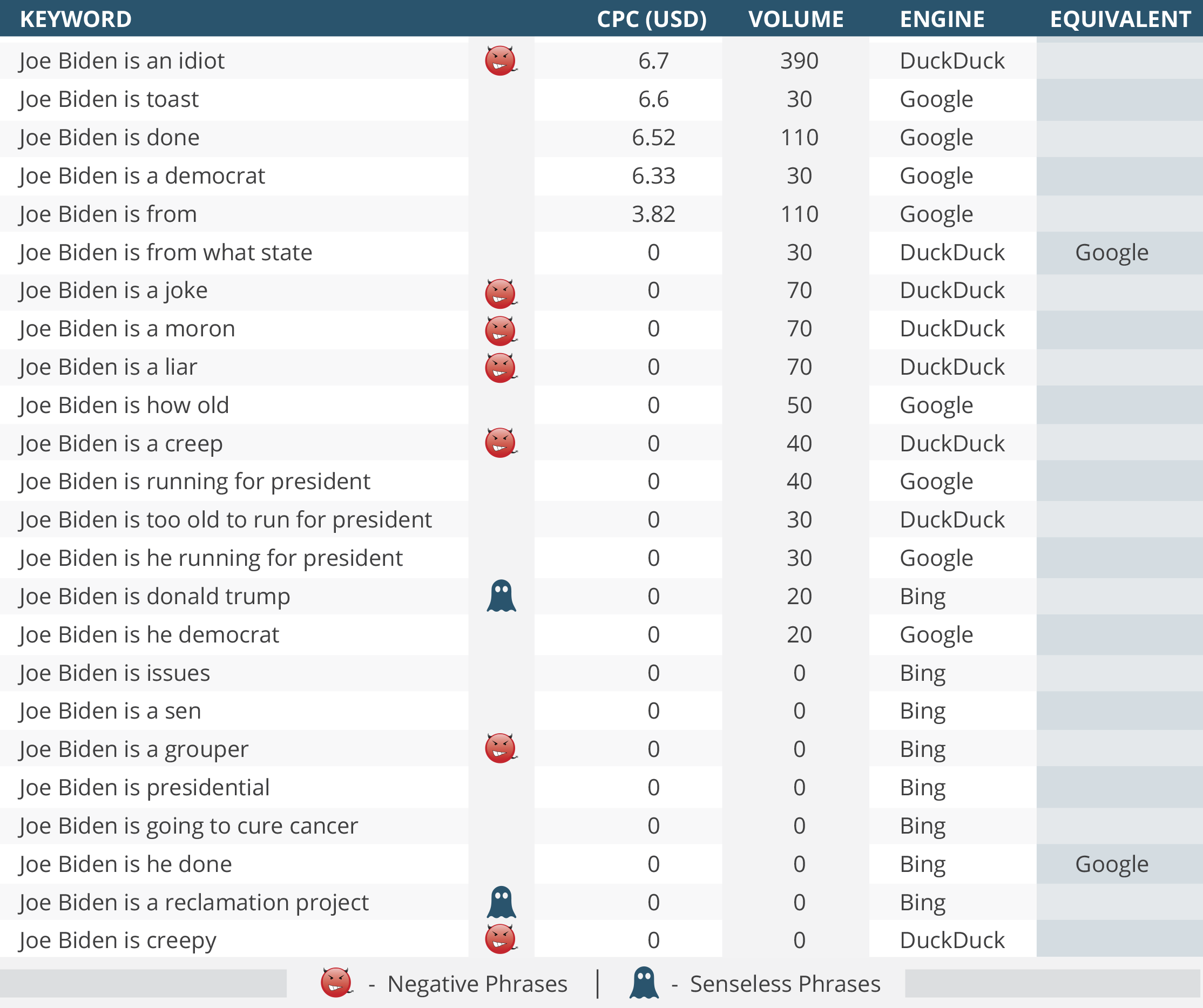

Wir haben uns die Floskel vom WSJ „Joe Biden is“ näher angeschaut.

Warum sollte Google eine Beschimpfung wie „Joe Biden is…“ […] „an Idiot“ oder „a liar“ einblenden? Vor allem als Aussage? Wollen Sie so etwas über Ihre Person öffentlich lesen? Wollen Sie als Rassist oder Jude betitelt werden? Warum sollte sich Google Rassismusvorwürfen aussetzen lassen, wie in Frankreich geschehen?

Wenn Sie eine Marke sind, dann wollen Sie meist sauber sein. „Don’t be Evil“ ist schon lange ein Claim von Google. Es gab ebenso Prozesse und Unterlassungsklagen, beispielsweise von Bettina Wulff im Zusammenhang mit den Vorschlägen von Google.

Warum sollte sich Google diesen Schuh anziehen? Und welche Suchantwort sollte man von „Joe Biden is an Idiot“ erwarten? Ja, nein, vielleicht?

Schon diese wenigen genannten Dinge zeigen, wie unausgereift die Recherche des WSJ an sich ist. Und wie nichtssagend einige der geprüften Floskeln sind. Wir haben den Versuch des WSJ auf unsere Weise nachgestellt. Daran kann man schon erkennen, wie sinnbefreit diese Recherche vom WSJ ist.

Für den Großteil der Bing-Ergebnisse gab es überhaupt keine Suchanfragen in Google: Also unter 10 Menschen stellen diese Frage pro Monat auf Google.com in den USA.

Warum sollte Google dies einblenden?

Die Suchanfragen von DuckDuckGo waren teilweise unter der Gürtellinie. Einige Suchanfragen ergeben auch gar keinen Sinn wie „Joe Biden is … Donald Trump“. Hä? Haben wir es etwa mit einer gespalteten Persönlichkeit zu tun?

Wenn man wirklich Hassreden und Beleidigungen sucht, dann muss man es eben in Google direkt eingeben. Und dort erscheint dann sicherlich auch, was man sucht – von anderen Anbietern. Aber nicht von Google direkt.

Warum sollte eine Fäkalsprache gefördert werden? Google richtet sich an alle Altersgruppen. Oder fänden Sie es gut, wenn Ihr Kind Ihnen am Frühstückstisch die besten Schimpfworte serviert? …

Oder wenn Ihre 14-jährige Tochter beim Googeln nach dem Vater den Vorschlag bekommt, dass dieser vielleicht ein Jude oder ein Trinker ist oder gar sein Geld in der Hafengegend ausgibt.

In der nachfolgenden Grafik sind die Suchbegriffe vom WSJ aufgelistet. Beleidigungen werden von Google ausgeblendet. Dies steht auch so in den Statuten von Google (4). Es ist auch kein Geheimnis.

Das dies von den anderen Suchmaschinen so angezeigt wird, zeigt in meinen Augen:

- Unausgereifte Algorithmen.

- Geringeres Verantwortungsbewusstsein gegenüber den Nutzern.

- Und eventuell zu wenig Klagen, das dies schmerzt.

Die Knaller waren die Suchfloskeln „Where do i buy heroin“ und „Heroin dosage“. Gut, das Google dafür keine Vorschläge macht. DuckDuckGo und Bing tun dies laut WSJ. Sogar Charts (Grafiken) werden vorgeschlagen. Bei normalen Floskeln wie „Recession“ waren die Mehrheit der Vorschläge gleichlautend.

Wie bereits beschrieben, gibt es eine offizielle Aussage zu Google, das bestimmte Ergänzungen nicht angezeigt werden.

Dagegen schreibt das WSJ:

„GOOGLE HAS BECOME more open about its moderation of auto-complete but still doesn’t disclose its use of blacklists. Kevin Gibbs, who created auto-complete in 2004 when he was a Google engineer, originally developed the list of terms that wouldn’t be suggested, even if they were the most popular queries that independent algorithms would normally supply.“ (3)

Was stellt sich das WSJ vor? Das WSJ scheint die Autosuggest-Funktion nicht von den normalen Suchergebnissen unterscheiden zu können.

„Google has said in congressional testimony it doesn’t use blacklists. Asked in a 2018 hearing whether Google had ever blacklisted a “company, group, individual or outlet…for political reasons,” Karan Bhatia, Google’s vice president of public policy, responded: “No, ma’am, we don’t use blacklists/whitelists to influence our search results,” according to the transcript.“ (3)

Mehr zu den Blacklist im Abschnitt „Google Verstehen: Part 2 – Blacklist & Strafen“

SEO und Content Marketing mit Verstand – wenn selbst Grundlagenwissen fehlt

Vor einiger Zeit gab es einen Aufschrei eines Unternehmers aus dem Bereich der alternativen Heilbehandlung, das Google seine Ergebnisse unterdrücken würde. (Nein, kein Kunde von mir).

Angeblich wäre auch das Autocomplete nicht so dargestellt worden, wie „ER“ es erwartet hatte. Er monierte genau das, was das WSJ mit seinem Benchmark tat. Und es wurde mit vielen eigenen Benchmarks der angebliche Beweis geliefert, das auch nur positive Wörter einblendet werden anstatt negativer und kritischer Worte.

Im Grunde wiederholte sich der Test von Part 1 und das Unwissen, wie Google Autocomplete funktioniert.

Warum seine „Wünsche und Ideen“ nicht für das Autocomplete eingeblendet wurden? Dafür gab es ganz klar einen Hintergrund: Keine oder kaum Suchanfragen bzw. andere Ergänzungen hatten ganz einfach mehr Suchanfragen.

Dass Google eine Negativliste an Wörtern hat, ist bereits seit 2010 bekannt – selbst veröffentlicht von Danny Sullivan und auch beschrieben in Referenz (4).

Ich habe mir dann als Seolotse den Spaß gemacht und habe seine Website in einem Website-Audit genauer untersucht. Es brauchte nicht lange: Massiver doppelter Content (DC), vielfach auf unzähligen Plattformen veröffentlicht. 1:1 – Duplicate Content in seiner reinsten und schlimmsten Form.

Und wer dann nicht versteht, wie Google arbeitet und selbst auf Ankündigungen von Google nicht reagiert, dass Mehrfach-Veröffentlichungen einfach ausgeblendet werden, der hat einfach nicht verstanden, was Content-Marketing und echtes SEO bedeuten. Ganz abgesehen von den vielen Badlinks.

Mit einem Website-Audit-Score von 49 % hat er dem Ganzen die Krone aufgesetzt. Es handelte sich also um eine sehr schlecht gepflegte Website. Im Grunde war es die am schlechtesten gepflegte Website, die ich jemals aktiv in einem Audit untersucht hatte.

Und dann wundern sich Personen, wenn ihre Websiten nicht im Index erscheinen oder eben auf Platz 200 sind und die Klickzahlen heruntergehen? Gute SEO-Beratung ist eben unbezahlbar. Als Mehrwert für Ihre Unternehmen natürlich. SEO steht dabei auch nicht für signifikante Mehrausgaben – wirklich. Denn es ist eine Investition. In Ihre Zukunft.

Google Verstehen: Part 2 – Blacklist & Strafen

Das WSJ spricht weiter über Blacklists. Was kann damit nur gemeint sein? Meinen die etwa diese Seiten, die massenhafte Inhalte von anderen Seiten scrappen, um die eigene Wertigkeit zu erhöhen, schlechte Backlinks setzen und einfach nur Unsinn treiben? Weil Sie sich erhoffen, eine hohe Autorität für die Website zu erhalten, um diese dann gewinnbringend zu verkaufen oder um hohe Werbeeinnahmen zu erzielen?

Dass die Autorität nicht vererbbar ist, ist hinlänglich bekannt. Und es zeugt von einem Unwissen darüber, wie Google eine Bewertung von Seiten durchführt. Und dass solche Scrape-Seiten und Badlink-Schleudern dann irgendwann von Google deindexiert werden, das ist selbstredend. Das WSJ beschreibt es ja selbst.

Und warum hindert Google bestimmte Websites, ein gutes Ranking zu erhalten oder bestimmt, dass Seiten deindexiert werden?

- Gestohlene, gescrapte, gespinnte Inhalte

- Doppelte Inhalte

- Suchmaschinenmanipulierung

- Black-Hat-SEO

- Technisches SEO ist einfach schlechter als bei der Konkurrenz

- Nichtbeachtung der Vorgaben von Google

- Verstoß gegen Werbeeinblendungen

- Backlinkpolitik

Gehen wir zurück ins Jahr 1997: Larry Page und Sergej Brin entwickelten damals Ihre eigene Suchmaschine. Und sie wurden dafür gefeiert. Basierend auf dem PageRank-Algorithmus lieferte Google damals die besten Ergebnisse.

Und wie die Natur einiger Menschen ist: der Mensch versucht sich alles unter die Nägel zu reißen, was drunter passt. Munter wurde manipuliert, um unschöne Ergebnisse ohne Mehrwert möglichst weit vorn in den Suchmaschinen zu positionieren.

Warum sollte Google minderwertige Ergebnisse ausliefern und dies alles hinnehmen?

Natürlich passt Google die Algorithmen an, um die möglichst besten Ergebnisse für User auszuliefern. So ist dies auch mit dem PageRank und unzähligen Core-Updates passiert. Google ging aktiv gegen Betrüger und Manipulanten vor.

Was passiert, wenn Google keine Besucher oder nur noch 50 % Marktanteil hätte? Man muss sich fragen, womit Google das meiste Geld verdient: Werbung! Ads! Und was passiert, wenn statt 3,8 Millionen Suchanfragen pro Minute nur 1,5 Millionen Suchanfragen vorliegen? Und demzufolge deutlich weniger potenzielle Klicks auf die Ads erfolgen?

Eine Spirale würde in Gang gesetzt: unzufriedene Aktionäre, Gewinneinbrüche. Im Jahre 2018 machte Google mittels Werbung ca. 116 Milliarden USD Umsatz, Alphabet als Mutterkonzern „nur“ knappe 137 Milliarden USD. Demzufolge steuert Google fast 85 % des Gesamtumsatzes des Mutterkonzerns bei, allein durch Werbung.

Stellen Sie sich vor, Sie bauen das beste Auto der Welt und das soll auch so bleiben. Sie haben die Reputation und den Markt und großartige Umsätze. Würden Sie sich dann die Butter vom Brot nehmen lassen und einen billigen Motor mit billigen Komponenten verbauen? Oder Dinge verbauen, mit denen der Fahrer zu Schaden kommen kann?

Sicherlich nicht.

So ist es ebenso mit Google. Google hat sich das Ziel gesetzt, die besten Suchergebnisse für seine Nutzer auszuliefern. Haben Sie schon mal andere Suchmaschinen ausprobiert und die Qualität der Ergebnisse verglichen?

Google und Niedriglohnarbeiter – Die Human Rater

Das WSJ berichtet weiter über „low-paid contractors“. Damit sind wohl die Human Rater gemeint. Google hat ein über 160 Seiten langes Papier darüber veröffentlicht, wie ideale Suchresultate aussehen sollten. Das Ganze geschah gestützt von Forschungen und Erfahrung sowie psychologischen Betrachtungsweisen.

Um die besten Suchresultate auszuliefern, werden eben diese menschlichen Bewerter in Studien einbezogen. Und mehr noch: jeder kann rein zufällig „Human Rater“ werden. Google kann Suchergebnisse für eine Zeit lang für eine ausgesuchte Gruppe anders darstellen als für die breite Masse (5).

Google führt jeden Tag Versuche durch, um die optimalen Suchergebnisse auszuliefern. Dabei kann einiges passieren: Rankings werden getauscht, Farben geändert usw. Und die Human Rater machen auch nichts anderes: Sie bewerten und die Google-Ingenieure füttern und konditionieren die AI und Rank Brain.

Auch hier beweist das WSJ ein Gespür dafür, Dinge anders darzustellen, als sie wirklich sind. Von Eye-Tracking-Studien und Forschung scheinen die Schreiberlinge nichts zu wissen. Oder bekommt jetzt jede Firma von den Kartellwächtern ärger, weil diese die Kaufentscheidungen optimieren?

Dazu Lara Levin von Google:

„We do today what we have done all along, provide relevant results from the most reliable sources available.”

„Wir tun heute, was wir die ganze Zeit getan haben, liefern relevante Ergebnisse aus den zuverlässigsten verfügbaren Quellen“.

Google zahlt übrigens 13,50 USD für diese „Niedriglohnarbeiter“. Mehr gibt es dazu nicht zu sagen.

Die SEO-Szene hat sich mit diesem Bericht des WSJ kritisch auseinandergesetzt. Eigentlich könnte man lachen und weinen zugleich (2). Es bleibt spannend, in welchen Foren alleinig der WSJ-Artikel unreflektiert auftaucht als „neueste SEO Tipps“. Ich freue mich immer wieder, wenn Kunden sagen: „Ich habe am Wochenende etwas über SEO recherchiert.“ Wunderschön.

Wenn das Wall Street Journal die SEO-Agentur ersetzt

contentbird.blog